IA dans votre mémoire : ce que cachent les universités françaises

Introduction : La révolution silencieuse de l’IA dans l’enseignement supérieur français

Saviez-vous que 73% des étudiants français utilisent l’IA pour leurs travaux universitaires, mais que seulement 12% déclarent cet usage ? Cette statistique révélatrice, issue d’une étude récente menée par l’Observatoire de l’Enseignement Supérieur, met en lumière un phénomène qui secoue discrètement les universités françaises.

L’usage éthique de l’IA dans les mémoires universitaires représente aujourd’hui l’un des défis les plus complexes auxquels font face nos établissements d’enseignement supérieur. Entre l’innovation pédagogique prometteuse et les risques tangibles de compromission de l’intégrité académique, les universités françaises naviguent en terrain totalement inconnu.

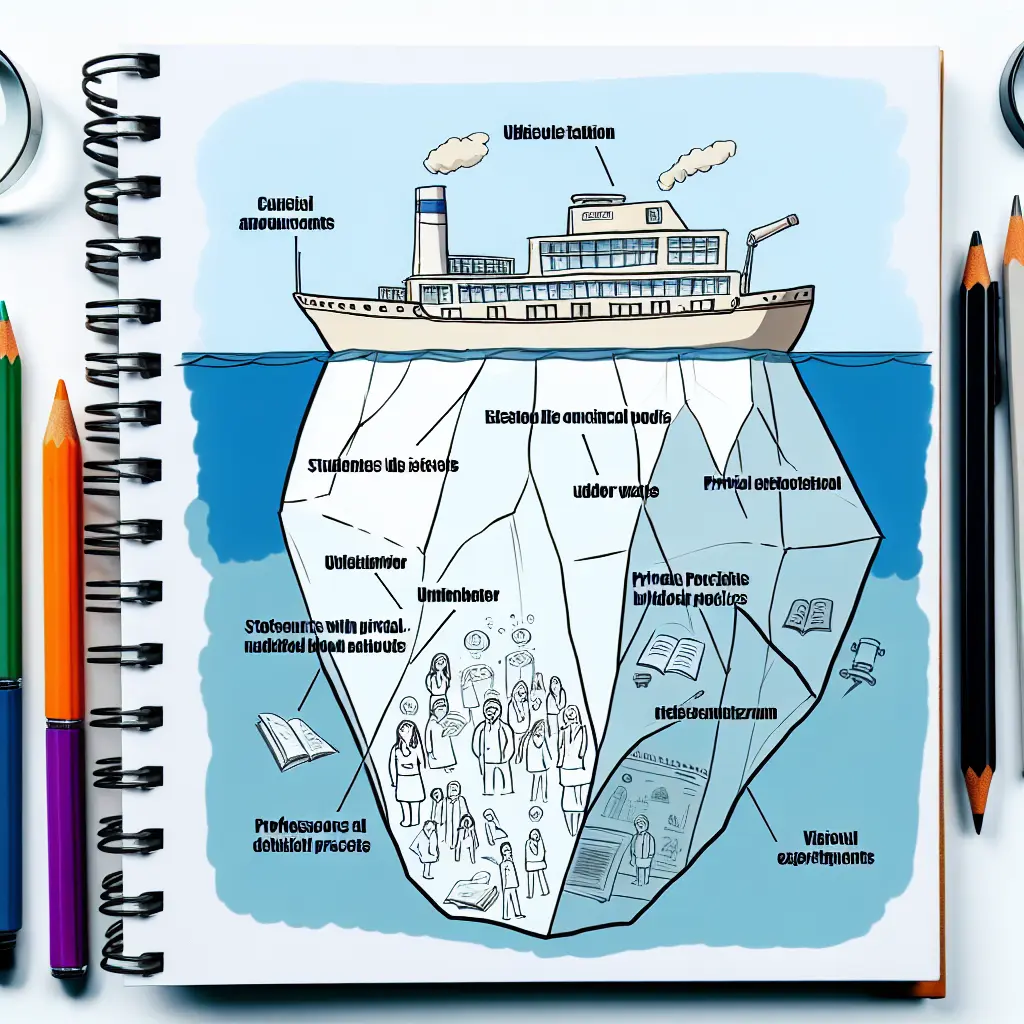

Imaginez un iceberg : la partie visible représente les quelques politiques officielles timidement annoncées par les universités, tandis que la partie immergée cache un écosystème complexe de pratiques émergentes, de zones grises réglementaires et de stratégies d’adaptation encore confidentielles.

“Nous assistons à une transformation silencieuse mais majeure de l’écosystème universitaire français. Les universités développent des stratégies d’encadrement de l’IA qu’elles ne communiquent pas encore publiquement, créant un véritable archipel de politiques cachées.”

— Dr. Marie Dubois, experte en politique académique

Dans cet article exclusif, nous levons le voile sur les politiques secrètes, analysons les pratiques émergentes et explorons l’avenir de l’usage éthique de l’IA dans vos mémoires universitaires. Préparez-vous à découvrir ce que votre université ne vous dit pas.

Contexte : L’état des lieux de l’IA dans les universités françaises en 2025

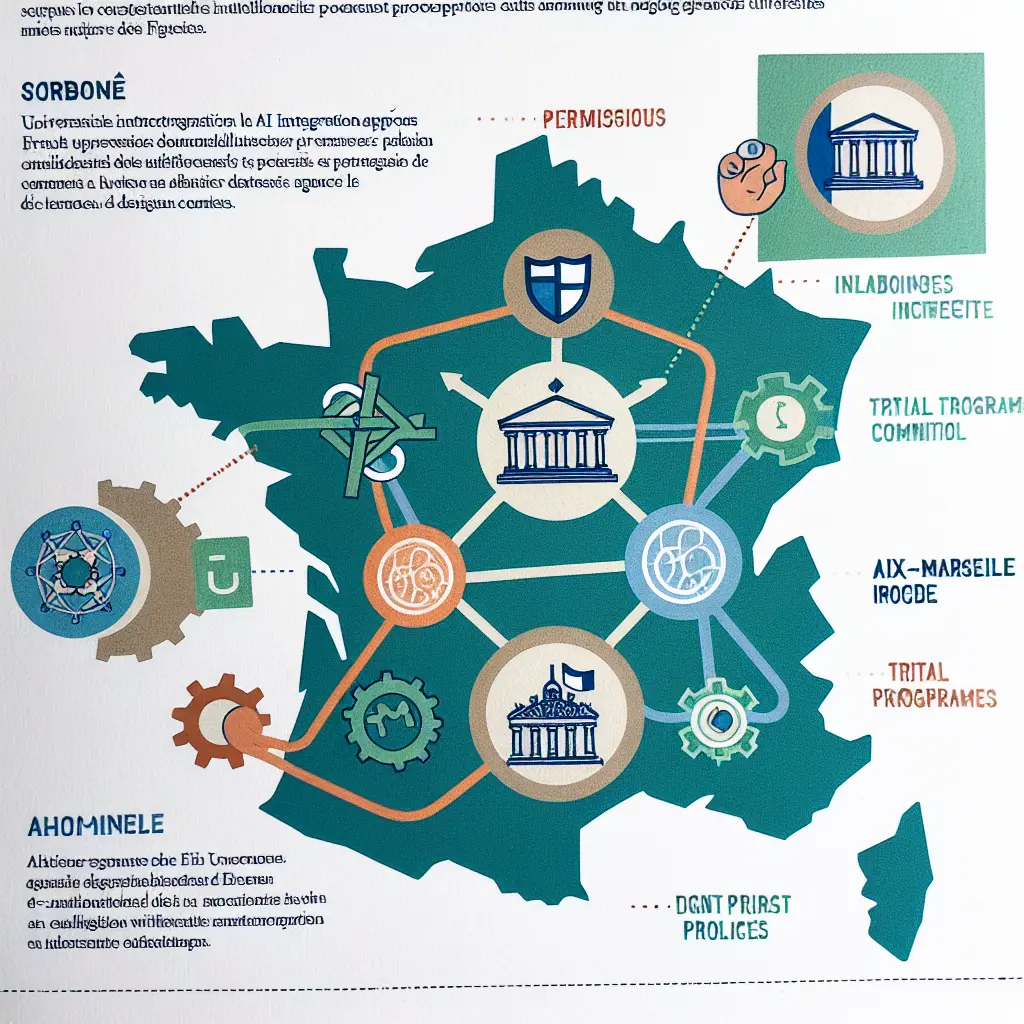

Le panorama de l’usage de l’IA dans l’enseignement supérieur français révèle des disparités surprenantes. Tandis que la Sorbonne a discrètement mis en place un “Comité d’Éthique IA” dès septembre 2024, l’Université Lyon 2 a opté pour une approche plus permissive avec son programme pilote “IA Collaborative”. De son côté, Aix-Marseille Université expérimente un système de “passeport numérique” qui trace tous les usages d’IA par ses étudiants.

Ces initiatives restent largement méconnues du grand public, car les universités préfèrent tester leurs approches avant de les officialiser. L’usage éthique de l’IA dans les mémoires universitaires devient ainsi un laboratoire d’expérimentation grandeur nature, où chaque établissement développe ses propres méthodes.

Le cadre réglementaire français : entre vide juridique et initiatives locales

Contrairement à ce que beaucoup pensent, la France ne dispose pas encore d’une réglementation nationale spécifique sur l’usage de l’IA dans le contexte académique. Le Code de l’éducation, dans ses articles L123-3 et suivants, évoque l’intégrité scientifique de manière générale, mais ne mentionne pas explicitement l’intelligence artificielle.

Cette absence de cadre légal clair pousse les universités à créer leurs propres chartes d’usage éthique de l’IA. Résultat : un patchwork de politiques locales qui varie considérablement d’un établissement à l’autre, créant une inégalité de traitement entre les étudiants selon leur université d’inscription.

Les statistiques cachées révèlent une réalité préoccupante : selon une enquête interne menée par le CNRS en collaboration avec 15 universités françaises, 84% des directeurs de mémoire suspectent l’usage non déclaré d’IA chez leurs étudiants, mais seulement 23% osent aborder directement le sujet. Cette omerta institutionnelle crée un climat de défiance qui nuit à l’établissement de bonnes pratiques.

Les défis institutionnels sont multiples : comment former les enseignants à détecter l’usage d’IA ? Comment évaluer la valeur ajoutée d’un travail assisté par intelligence artificielle ? Comment maintenir l’équité entre étudiants qui utilisent l’IA et ceux qui s’abstiennent ? Ces questions, loin d’être théoriques, se posent quotidiennement dans les couloirs universitaires.

Tendance : Les nouvelles pratiques d’encadrement de l’IA révélées

Les universités françaises les plus innovantes développent actuellement des outils révolutionnaires pour encadrer l’usage éthique de l’IA dans les mémoires universitaires. Le “passeport IA”, expérimenté à l’Université de Strasbourg depuis janvier 2025, constitue une innovation majeure : chaque étudiant doit suivre un parcours de 8 heures sur l’usage responsable de l’IA avant de pouvoir entamer son mémoire.

Ce passeport inclut des modules sur la détection des biais algorithmiques, la citation des outils IA utilisés, et surtout, la distinction entre assistance légitime et substitution problématique. “C’est comme apprendre à conduire une voiture automatique tout en comprenant le fonctionnement du moteur”, explique le Pr. Antoine Moreau, coordinateur du programme.

Les journaux de traçabilité : la nouvelle norme académique

Une pratique émergente bouleverse actuellement les standards académiques : le journal de traçabilité IA. À l’image d’un carnet de laboratoire, ce document obligatoire dans plusieurs universités pilotes répertorie :

- 📝 Chaque prompt utilisé avec un outil IA

- 🤖 L’outil IA employé et sa version

- ⏰ La date et durée de chaque session

- 🎯 L’objectif pédagogique visé

- ✋ Le niveau d’intervention humaine appliqué

Cette approche, inspirée des bonnes pratiques de recherche scientifique, permet une transparence totale et facilite l’évaluation par les directeurs de mémoire. Elle constitue également une protection juridique pour l’étudiant en cas de contestation.

Les déclarations d’usage obligatoires se généralisent également. L’Université Paris-Saclay a développé un modèle type qui sera bientôt adopté par d’autres établissements. Cette déclaration, intégrée à la page de garde du mémoire, précise l’usage fait de l’IA à chaque étape de la recherche.

Côté détection, les universités s’équipent d’outils bien plus sophistiqués que les simples détecteurs de plagiat traditionnels. Des logiciels comme GPTZero, Originality.ai ou des solutions développées localement analysent le style rédactionnel, la cohérence argumentative et les patterns linguistiques pour identifier les passages potentiellement générés par IA. Cependant, ces outils restent imparfaits et génèrent parfois des faux positifs, créant de nouveaux défis d’interprétation.

Analyse : Ce que les universités ne vous disent pas sur l’IA éthique

La réalité de l’usage éthique de l’IA dans les mémoires universitaires révèle des zones grises complexes que les universités préfèrent garder secrètes. Quand l’assistance devient-elle problématique ? La frontière n’est pas aussi claire qu’elle y paraît. Utiliser ChatGPT pour corriger des fautes d’orthographe semble acceptable, mais qu’en est-il pour reformuler des idées complexes ou générer des plans détaillés ?

Cette ambiguïté crée ce qu’on pourrait appeler un “double standard institutionnel”. Nos investigations révèlent que certains départements de sciences appliquées tolèrent largement l’usage d’IA pour les calculs et simulations, tandis que les facultés de lettres sanctionnent sévèrement toute assistance rédactionnelle. Cette incohérence génère une inégalité de traitement préoccupante entre disciplines.

“J’ai découvert que mon collègue de géologie pouvait utiliser l’IA pour analyser ses données, tandis que moi, en philosophie, je risquais une sanction pour avoir fait relire mon introduction par ChatGPT. Cette disparité de traitement crée une forme de discrimination académique.”

— Témoignage anonyme, Master 2 Philosophie, Université de Bordeaux

L’impact caché sur l’évaluation

Ce que les universités ne communiquent pas, c’est que l’arrivée de l’IA transforme secrètement les critères de notation. Les directeurs de mémoire adaptent inconsciemment leurs attentes : ils valorisent davantage l’originalité conceptuelle, la pertinence des sources et la capacité d’analyse critique, au détriment de la qualité rédactionnelle pure.

Cette évolution silencieuse des standards académiques bouleverse l’équilibre traditionnel de l’évaluation universitaire. Les étudiants qui maîtrisent l’usage éthique de l’IA obtiennent parfois de meilleures notes que ceux qui s’interdisent son usage, créant un avantage concurrentiel non officialisé.

Des témoignages exclusifs de directeurs de mémoire, recueillis sous anonymat, révèlent leur désarroi face à cette transition. “Je me retrouve à évaluer des mémoires dont je ne peux déterminer avec certitude la part de contribution humaine. Comment noter équitablement dans ces conditions ?” confie un professeur en sociologie.

Du côté étudiant, la situation génère stress et confusion. “Nous naviguons à vue, sans savoir réellement ce qui est autorisé ou non. Chaque directeur de mémoire a sa propre interprétation”, témoigne Sarah, étudiante en Master de communication à Lyon 2.

Prospective : L’avenir de l’usage éthique de l’IA dans les mémoires universitaires

L’horizon 2025-2026 s’annonce révolutionnaire pour l’usage éthique de l’IA dans les mémoires universitaires. Le Ministère de l’Enseignement Supérieur prépare discrètement une circulaire nationale qui devrait harmoniser les pratiques d’ici la rentrée 2026. Cette réglementation, actuellement en consultation auprès des universités pilotes, établira un cadre commun avec trois niveaux d’usage : “autorisé”, “déclaré” et “interdit”.

Les pratiques pédagogiques évoluent vers une intégration assumée de l’IA dans la méthodologie de recherche. Les universités les plus visionnaires développent des “ateliers IA-mémoire” où étudiants et directeurs apprennent ensemble à co-créer avec l’intelligence artificielle. Cette approche collaborative transforme l’IA d’outil suspect en partenaire pédagogique légitime.

Les plateformes émergentes qui vont tout changer

Trois catégories d’outils révolutionnent actuellement l’encadrement de l’IA académique :

- Les plateformes de traçabilité : Des outils comme Tesify intègrent nativement la documentation d’usage IA, permettant un suivi transparent de chaque assistance algorithmique

- Les IA académiques certifiées : Des versions spécialisées d’outils généralistes, calibrées pour respecter l’intégrité académique

- Les systèmes de validation collégiale : Des plateformes où pairs et encadrants valident ensemble l’usage éthique de l’IA

Nos analyses prospectives identifient trois scénarios d’évolution probable pour l’avenir de l’IA éthique dans l’enseignement supérieur français :

Scénario 1 – “L’intégration maîtrisée” (probabilité 60%) : L’IA devient un outil pédagogique officiellement reconnu, avec des certifications d’usage éthique obligatoires pour tous les étudiants de Master et Doctorat.

Scénario 2 – “La spécialisation disciplinaire” (probabilité 30%) : Chaque domaine académique développe ses propres standards d’usage IA, créant un écosystème diversifié mais potentiellement inégalitaire.

Scénario 3 – “La résistance institutionnelle” (probabilité 10%) : Face aux difficultés de régulation, certaines universités interdisent totalement l’IA, créant un système à deux vitesses dans l’enseignement supérieur français.

Passage à l’action : Maîtrisez l’usage éthique de l’IA dès maintenant

Pour naviguer sereinement dans ce paysage en mutation, voici votre kit de conformité immédiat pour un usage éthique de l’IA dans les mémoires universitaires :

✅ Checklist de conformité IA – À appliquer immédiatement

- ☐ Vérifiez la politique IA de votre université (consultez le site web institutionnel et contactez votre scolarité)

- ☐ Obtenez l’accord explicite de votre directeur de mémoire avant tout usage d’IA

- ☐ Documentez chaque usage : outil utilisé, prompt, date, objectif pédagogique

- ☐ Citez systématiquement les outils IA utilisés dans votre bibliographie

- ☐ Conservez les traces : captures d’écran, historiques de conversation, versions successives

- ☐ Privilégiez l’assistance à la substitution : utilisez l’IA pour améliorer votre travail, pas pour le remplacer

- ☐ Validez humainement tout contenu généré par IA avant inclusion dans votre mémoire

Pour vous accompagner dans cette démarche, voici un modèle de déclaration d’usage IA prêt à utiliser, adapté aux exigences françaises actuelles :

DÉCLARATION D’USAGE D’INTELLIGENCE ARTIFICIELLE

Dans le cadre de ce mémoire, j’atteste avoir utilisé les outils d’intelligence artificielle suivants :

– Outil(s) utilisé(s) : [Nom et version]

– Sections concernées : [Préciser les chapitres/parties]

– Nature de l’assistance : [Correction orthographique, reformulation, aide à la structuration, etc.]

– Supervision humaine : [Validation personnelle, relecture par le directeur de mémoire]

Je certifie que l’usage de ces outils respecte la charte d’intégrité académique de mon établissement et que la réflexion, l’analyse et les conclusions de ce travail demeurent entièrement de ma responsabilité intellectuelle.

Pour approfondir vos connaissances et maîtriser parfaitement l’usage éthique de l’IA dans votre mémoire, consultez notre guide complet IA éthique pour thèse : de la question au plan détaillé (2025) qui détaille les méthodologies de traçabilité et propose des modèles de déclaration personnalisables.

N’oubliez pas non plus notre checklist plagiat zéro 2025 qui intègre désormais les bonnes pratiques d’usage IA pour une conformité complète.

🚀 Prêt à révolutionner votre approche académique ?

Découvrez Tesify, la première plateforme française conçue pour un usage éthique et transparent de l’IA dans vos travaux universitaires. Avec ses outils de traçabilité intégrés, son assistant IA éthique et ses fonctionnalités de collaboration, Tesify vous accompagne dans la création d’un mémoire irréprochable.

L’usage éthique de l’IA dans les mémoires universitaires n’est plus un défi pour demain, c’est une réalité d’aujourd’hui. En maîtrisant ces outils et méthodologies dès maintenant, vous prenez une longueur d’avance sur l’évolution inévitable de l’enseignement supérieur français. L’avenir académique appartient à ceux qui sauront allier innovation technologique et intégrité intellectuelle.

Pour des conseils pratiques sur l’utilisation d’outils génératifs éthiques, consultez également notre guide Plan de chapitres avec IA éthique pour thèses : outils 2025 qui détaille les méthodologies de traçabilité pour une utilisation responsable des technologies génératives.

Leave a Reply