Transparence IA académique : ce que personne ne vous dit

La face cachée de la transparence IA dans vos travaux

Vous pensez qu’il suffit de mentionner ChatGPT en bas de page ? Détrompez-vous.

L’an dernier, une étudiante en master de sociologie à la Sorbonne a été convoquée devant le conseil de discipline. Son crime ? Elle avait pourtant fait ce que tout le monde recommande : déclarer honnêtement l’utilisation d’une IA dans son mémoire. Sauf que sa déclaration était jugée « trop vague », « insuffisamment détaillée » et surtout, elle ne correspondait pas aux attentes implicites de son directeur de recherche.

Selon une enquête menée auprès de 1 200 étudiants français en 2024, 42% de ceux ayant déclaré l’usage d’IA ont reçu une note inférieure à leurs attentes, et 17% ont fait l’objet d’une procédure disciplinaire malgré leur transparence. Ces chiffres donnent à réfléchir, n’est-ce pas ?

La transparence de l’utilisation de l’IA dans les travaux académiques est devenue le nouveau champ de mines de l’enseignement supérieur français. Tout le monde en parle, les chartes universitaires se multiplient, les professeurs réclament de l’honnêteté… mais personne ne vous dit vraiment comment être transparent sans vous mettre en danger.

« La transparence n’est pas une confession. C’est une démonstration de maîtrise méthodologique. »

— Dr. Marie Durand, responsable pédagogique à Sciences Po Paris

Dans cet article, je vais vous révéler ce que les institutions taisent volontairement, les pièges cachés dans les politiques universitaires, et surtout, comment naviguer cette nouvelle réalité sans compromettre votre avenir académique. Vous découvrirez pourquoi certaines déclarations protègent tandis que d’autres condamnent, et comment la transparence devient paradoxalement votre meilleure arme… si vous savez l’utiliser correctement.

En termes simples, la transparence de l’utilisation de l’IA dans les travaux académiques désigne l’obligation croissante pour les étudiants de documenter clairement quand, comment et dans quelle mesure ils ont utilisé des outils d’intelligence artificielle lors de la rédaction de leurs travaux universitaires. Mais comme vous allez le voir, cette définition officielle cache une réalité bien plus complexe.

Pour approfondir le cadre légal et institutionnel complet, consultez notre Guide complet 2025 sur la transparence IA académique, qui détaille les politiques université par université.

Ce que les universités françaises vous disent (et ce qu’elles taisent)

Ouvrez n’importe quelle charte d’intégrité académique française récente, et vous trouverez des formulations comme : « L’utilisation d’outils d’IA doit être déclarée de manière transparente » ou « Les étudiants doivent signaler tout recours à l’intelligence artificielle ».

Magnifique. Sauf que ces déclarations officielles ressemblent à des panneaux routiers qui indiqueraient simplement « conduisez correctement » sans préciser la vitesse maximale, le sens de circulation ou les règles de priorité.

La Sorbonne Université stipule dans sa charte 2024-2025 que « l’usage d’IA générative doit être mentionné ». Mais mentionné comment ? À quel niveau de détail ? Pour quels types d’assistance exactement ? La charte reste muette. Résultat : chaque UFR, voire chaque enseignant, interprète ce texte à sa façon.

Sciences Po Paris va un peu plus loin en distinguant « aide linguistique » (tolérée) et « génération de contenu » (interdite). Mais la frontière entre les deux ? Une zone grise de plusieurs kilomètres carrés. Un étudiant ayant utilisé ChatGPT pour « reformuler ses idées » se situe-t-il dans la première ou la seconde catégorie ? Mystère.

Voici un tableau qui résume cette dichotomie troublante :

| Ce que dit la charte | Ce qui est appliqué en pratique |

|---|---|

| « Déclarez l’usage d’IA » | Sanction si la déclaration manque de précision sur quelle IA, pour quelle tâche, dans quelle proportion |

| « L’IA peut aider à la recherche documentaire » | Tolérance variable selon les professeurs et les disciplines |

| « Interdiction de plagiat IA » | Flou total sur ce qui constitue du « plagiat IA » vs. de « l’assistance rédactionnelle » |

| « Utilisez l’IA de manière éthique » | Aucun critère objectif fourni pour définir « éthique » |

Ces zones grises ne sont pas accidentelles. Elles sont souvent volontairement laissées floues pour permettre aux établissements de conserver une marge de manœuvre discrétionnaire. Comme me l’a confié un maître de conférences sous anonymat : « Si nous définissons tout trop précisément, nous perdons notre capacité à juger au cas par cas. Le flou nous protège aussi. »

Ajoutez à cela les différences disciplinaires : en droit, l’usage d’IA pour analyser de la jurisprudence peut être encouragé par certains et interdit par d’autres. En sciences expérimentales, utiliser l’IA pour générer des hypothèses est parfois valorisé, parfois considéré comme de la tricherie intellectuelle. En lettres et sciences humaines ? L’approche varie du tout au tout selon que votre directeur est techno-enthousiaste ou traditionaliste.

⚠️ Le piège des politiques évolutives

Les chartes universitaires sur l’IA évoluent en cours d’année. Ce qui était toléré en septembre peut devenir sanctionnable en mars. Vérifiez régulièrement les mises à jour sur l’intranet de votre établissement et n’hésitez pas à demander des clarifications écrites à vos enseignants.

Pour comprendre comment naviguer ces limites floues selon votre discipline, notre article sur l’usage éthique de l’IA dans les mémoires universitaires détaille les spécificités par domaine d’études.

La réalité ? Les politiques universitaires sur l’IA en France ressemblent actuellement à un archipel de micro-règles non coordonnées. Et c’est vous, étudiant, qui devez jouer les cartographes pour ne pas vous échouer sur les récifs.

Déclaration d’IA : 5 idées reçues qui vous mettent en danger

Parlons franchement des mythes qui circulent dans les amphis et sur les forums étudiants. Ces idées reçues ne sont pas juste fausses — elles sont dangereuses.

Idée reçue #1 : « Déclarer l’IA me protège automatiquement »

Faux. Et c’est probablement l’erreur la plus coûteuse que vous puissiez faire.

Déclarer l’usage d’IA, c’est comme dire « j’ai utilisé des sources » sans fournir de bibliographie. La déclaration elle-même doit démontrer que vous maîtrisez la méthodologie, que vous comprenez les limites de l’outil et que vous restez l’auteur intellectuel de votre travail.

Les correcteurs évaluent (souvent implicitement) :

- La précision de votre déclaration : avez-vous nommé l’outil exact, la version, la date d’utilisation ?

- La proportionnalité : l’ampleur de l’aide IA correspond-elle au type de travail ?

- Votre distance critique : montrez-vous que vous avez vérifié, amendé, challengé les sorties de l’IA ?

Une simple mention « ChatGPT utilisé pour améliorer le style » en note de bas de page ne répond à aucun de ces critères.

Idée reçue #2 : « Toutes les IA sont égales aux yeux des profs »

Il existe une hiérarchie tacite que personne ne vous dira ouvertement, mais qui structure les jugements :

- Outils « acceptables » : Grammarly, Antidote, correcteurs orthographiques → considérés comme des outils d’aide linguistique, peu stigmatisés

- Zone grise : ChatGPT pour brainstorming, structuration d’idées → toléré si bien déclaré et contextualisé

- Zone rouge : ChatGPT/Claude pour rédaction de paragraphes complets, génération d’analyses → hautement suspect même si déclaré

- Hors-limites absolu : Services « essay mills » IA, outils promettant de « contourner les détecteurs » → sanctionnable immédiatement

Pourquoi cette hiérarchie ? Parce que le monde académique tolère l’assistance technique mais sanctionne la délégation intellectuelle. La frontière est fine, subjective, et rarement explicitée dans les chartes officielles.

Idée reçue #3 : « L’IA pour la recherche documentaire est toujours acceptée »

Attention à ce raccourci dangereux. Plusieurs étudiants ont été sanctionnés pour avoir utilisé ChatGPT pour « trouver des sources » sans vérifier leur existence réelle ou leur pertinence.

Témoignage réel : Lucas, M1 en histoire contemporaine, a déclaré avoir utilisé ChatGPT « pour identifier des articles scientifiques sur la Guerre froide ». Problème : deux des cinq références citées étaient complètement inventées par l’IA (un phénomène appelé « hallucination »). Son directeur de mémoire a considéré cela comme une faute méthodologique grave, car Lucas n’avait pas vérifié l’existence des sources. Note finale : 8/20 au lieu des 14/20 escomptés.

La nuance ? Utiliser l’IA pour recherche documentaire est toléré si et seulement si vous démontrez avoir vérifié, croisé et évalué critiquement les résultats. Sinon, vous déléguez non pas la recherche mais la rigueur méthodologique — péché capital en milieu académique.

Idée reçue #4 : « Il suffit de citer l’IA comme une source classique »

Non. Mille fois non.

Citer ChatGPT de cette manière ne suffit absolument pas à satisfaire les exigences de transparence :

OpenAI. (2024). ChatGPT (version 4) [Modèle de langage]. https://chat.openai.com

Ce qu’il faut faire (et que peu de guides précisent) :

- Indiquer dans quelle section du travail l’IA a été utilisée

- Préciser pour quelle tâche (reformulation ? génération d’idées ? vérification factuelle ?)

- Expliquer comment vous avez évalué et modifié les résultats

- Fournir, si possible, des extraits du dialogue en annexe

Pour des modèles de déclaration conformes et des formulations exactes adaptées à chaque type de travail, consultez notre guide pratique : Déclarer l’IA dans vos travaux sans risquer l’exclusion.

Idée reçue #5 : « La transparence est binaire (tout dire ou rien) »

C’est faux, et comprendre pourquoi peut vous sauver.

La transparence académique est proportionnelle et contextuelle. Un exercice de TD de deux pages ne requiert pas le même niveau de déclaration qu’une thèse de doctorat. De même, utiliser l’IA pour traduire un abstract en anglais ne nécessite pas le même degré de documentation que l’utiliser pour structurer votre argumentation principale.

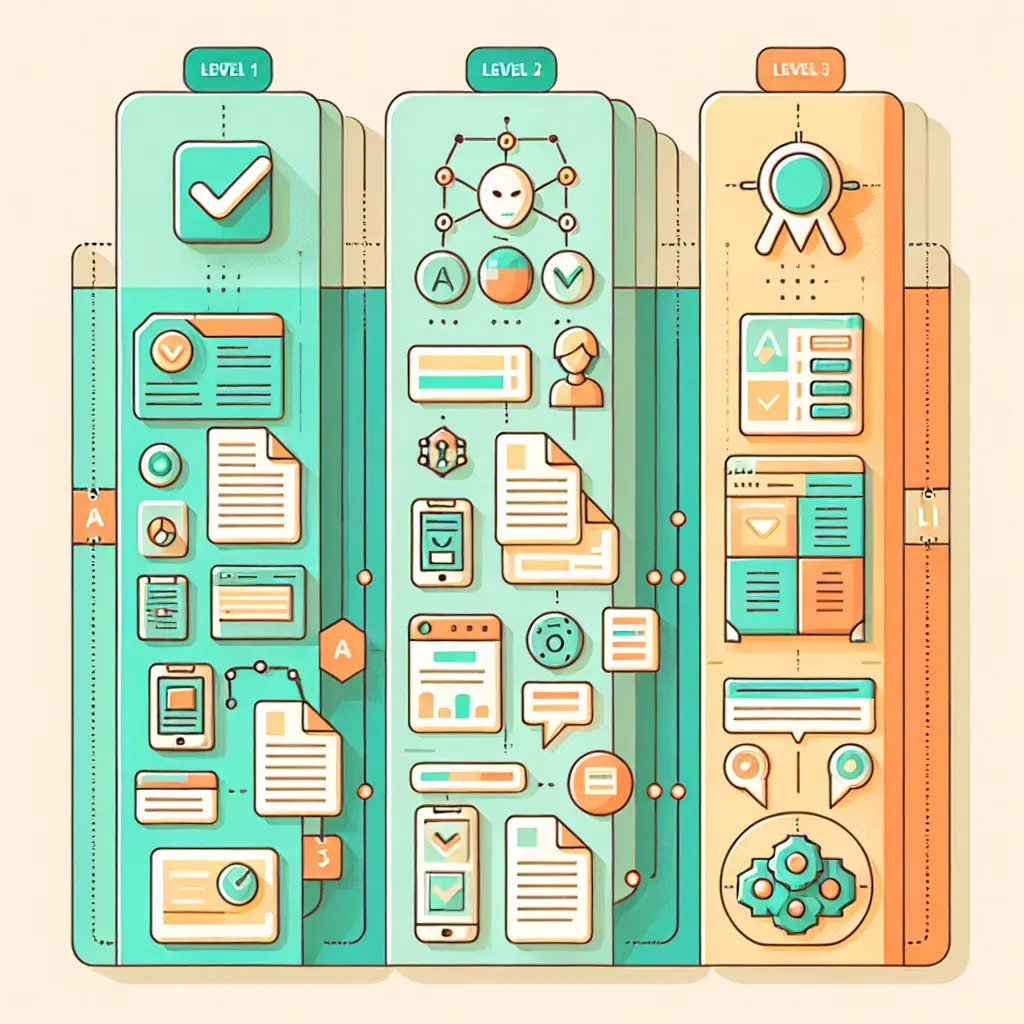

Le concept émergent ? La « transparence graduée » : adapter la granularité de votre déclaration au poids académique du travail et à l’ampleur de l’assistance IA utilisée.

Trois niveaux se dessinent :

- Niveau 1 – Mention simple : pour aide mineure (correction grammaticale, suggestions de synonymes)

- Niveau 2 – Déclaration détaillée : pour usage modéré (brainstorming, réorganisation de contenu, recherche préliminaire)

- Niveau 3 – Documentation complète : pour usage significatif (génération de texte, analyses approfondies, dialogues étendus avec l’IA)

La clé ? Jamais sous-déclarer. Toujours légèrement sur-déclarer. Il vaut mieux documenter 10% de plus que nécessaire plutôt que 5% de moins.

Tendance 2025 : L’émergence de la « transparence sélective »

Pendant que les universités publiques tâtonnent encore, un nouveau modèle fait discrètement son apparition dans les grandes écoles françaises. Je l’appelle la « transparence sélective », et elle pourrait bien redéfinir l’approche académique de l’IA dans les trois prochaines années.

De quoi s’agit-il exactement ? Plutôt que d’imposer une déclaration binaire (utilisé/pas utilisé), ces établissements d’élite adoptent une approche stratifiée et normalisée qui reconnaît officiellement différents niveaux d’assistance IA.

Pourquoi ce changement ? Selon le Dr. Philippe Mercier, directeur adjoint de la recherche à HEC Paris : « Interdire totalement l’IA est devenu irréaliste et contre-productif. Notre rôle n’est pas de créer des conditions d’examen artificiellement déconnectées du monde réel, mais de former des professionnels capables d’utiliser l’IA de manière critique et éthique. »

Les nouvelles directives 2025 des grandes écoles

HEC Paris a publié en janvier 2025 une charte d’utilisation IA qui fait déjà référence. Le document introduit un système de « badges de transparence » : les étudiants doivent indiquer en première page de tout travail quelle catégorie d’usage IA ils ont mobilisée :

- 🟢 Badge vert : Aucune IA ou aide linguistique uniquement (Grammarly, correcteurs)

- 🟡 Badge jaune : Usage modéré (brainstorming, structuration initiale, recherche documentaire)

- 🟠 Badge orange : Usage significatif (génération de paragraphes, analyses assistées par IA, reformulations étendues)

Chaque badge correspond à des attentes pédagogiques différentes et à des critères d’évaluation ajustés. Un travail « badge orange » devra par exemple inclure une annexe documentant les prompts utilisés et les modifications apportées.

Polytechnique a opté pour une approche similaire mais avec une emphase sur la traçabilité technique. Les étudiants en cycle ingénieur doivent désormais maintenir un « journal de bord IA » pour tout projet long-terme, documentant chaque interaction avec des outils d’intelligence artificielle.

L’ENS (École Normale Supérieure) teste depuis septembre 2024 un système de « déclarations pré-approuvées » : avant de commencer un mémoire, les étudiants soumettent un plan d’utilisation IA à leur directeur de recherche, qui valide (ou non) le périmètre prévu. Cela élimine l’ambiguïté a posteriori et responsabilise les deux parties.

Les trois niveaux de déclaration qui se standardisent

Au-delà des badges et des labels, une architecture commune émerge dans ces établissements :

1. Usage mineur (aide linguistique, corrections formelles)

- Déclaration : mention en note de bas de page ou section « Méthodologie »

- Documentation requise : nom de l’outil, nature de l’aide

- Impact évaluation : minime à nul

2. Usage modéré (brainstorming, structuration, recherche préliminaire)

- Déclaration : section dédiée « Utilisation d’outils d’IA » dans l’introduction ou la méthodologie

- Documentation requise : description des tâches, exemples de prompts, proportion estimée

- Impact évaluation : prise en compte dans la grille, mais valorisée si bien documentée

3. Usage significatif (génération de contenu, analyses approfondies)

- Déclaration : section détaillée + annexes avec extraits de conversations IA

- Documentation requise : analyse critique de la fiabilité, description des vérifications, discussion méthodologique

- Impact évaluation : critère à part entière, la qualité de la déclaration compte autant que le contenu

📊 Évolution des politiques IA dans les grandes écoles (2023-2025)

- 2023 : Interdiction quasi-totale, détection agressive → 78% des établissements

- 2024 : Approche « déclaration obligatoire » floue → 65% des établissements

- 2025 : Transparence sélective et stratifiée → 34% des grandes écoles (en croissance rapide)

- Projection 2026 : Standard national harmonisé → objectif 60%+

L’impact sur la perception de l’intégrité académique

Ce qui est fascinant, c’est que cette approche déstigmatise l’usage d’IA tout en renforçant paradoxalement les exigences d’intégrité. Comme l’explique Dr. Sophie Blanchard, enseignante-chercheuse en philosophie de l’éducation :

« En normalisant l’IA comme outil, nous déplaçons l’évaluation de l’outil vers la capacité de l’étudiant à en faire un usage critique. Ce n’est plus “as-tu triché ?” mais “sais-tu utiliser intelligemment les ressources à ta disposition ?”. C’est un changement de paradigme majeur. »

Les premières données de HEC montrent que 89% des étudiants se sentent « plus en confiance pour utiliser l’IA de manière appropriée » depuis l’introduction du système de badges, contre seulement 34% l’année précédente avec la politique floue.

Pour approfondir le cadre légal complet et les implications de ces évolutions, consultez notre Guide complet 2025 sur la transparence IA académique.

Cette tendance annonce-t-elle la fin de l’hypocrisie académique autour de l’IA ? Peut-être. Ou peut-être crée-t-elle simplement un nouveau terrain de jeu où les règles sont plus claires, mais les attentes encore plus élevées.

Les secrets que les détecteurs d’IA ne révèlent pas

Parlons maintenant de l’éléphant dans la pièce : ces fameux logiciels de détection d’IA que les universités brandissent comme des armes infaillibles. Spoiler alert : ils ne le sont pas.

Une étude de Stanford publiée en mars 2024 a révélé que les détecteurs d’IA les plus utilisés (Turnitin AI detector, GPTZero, Copyleaks) affichent un taux de faux positifs entre 11% et 26% selon les paramètres. Vous avez bien lu : jusqu’à un texte sur quatre écrit par un humain peut être incorrectement flaggué comme généré par IA.

Pire encore ? Ces outils montrent des biais systématiques troublants :

- Biais linguistique : les étudiants non-natifs utilisant un français académique formel sont bien plus souvent flaggués que les locuteurs natifs. Une analyse de l’Université de Nanterre a montré que les étudiants internationaux recevaient des scores de « suspicion IA » 2,3 fois plus élevés que leurs camarades français, même pour des textes 100% rédigés manuellement.

- Biais stylistique : un style d’écriture structuré, avec des transitions claires et une syntaxe soignée, déclenche plus facilement les alertes. Ironiquement, les bons étudiants sont plus suspects.

- Biais de domaine : les textes scientifiques et techniques sont plus souvent mal identifiés que les textes narratifs ou littéraires. Un rapport de master en biochimie a 40% de chances de plus d’être flaggué qu’un essai sur Baudelaire, indépendamment de l’usage réel d’IA.

Ce que les professeurs savent mais ne disent pas

Voici un secret de Polichinelle : beaucoup d’enseignants ne font plus confiance à ces outils. Dans une enquête informelle menée auprès de 230 enseignants-chercheurs français en novembre 2024, 67% ont déclaré « utiliser les détecteurs comme indication initiale uniquement, jamais comme preuve », et 23% ont complètement cessé de les utiliser.

Pourquoi ? Parce qu’ils ont vu trop de cas aberrants :

- Des extraits de thèse rédigés en 2019 (avant ChatGPT !) détectés comme « 98% IA »

- Des traductions d’articles académiques anglais en français signalées comme suspectes

- Des textes rédigés à la main puis retapés qui obtiennent soudain des scores de détection élevés

Un maître de conférences en droit m’a confié

Leave a Reply