La question que tout doctorant se pose en secret

Avouez-le. Vous avez utilisé ChatGPT pour reformuler ce paragraphe qui vous résistait depuis trois jours. Ou peut-être avez-vous demandé à l’IA de vous aider à structurer vos idées. Rien de bien méchant, pensez-vous. Puis arrive le moment fatidique : vous soumettez votre chapitre à votre directeur de thèse, et le rapport Turnitin affiche “23% AI detected”.

Panique totale.

Votre cœur s’emballe. Vous imaginez déjà le jury, les sourcils froncés, brandissant ce pourcentage comme preuve irréfutable de votre “tricherie”. Vous vous précipitez sur Google pour chercher des réponses : “seuils de pourcentage IA autorisés”, “limite IA mémoire”…

Et là, c’est le vide. Ou pire : des informations contradictoires, des forums où chacun y va de son avis, des rumeurs sur des étudiants exclus pour 15%, d’autres validés avec 35%…

🎯 Réponse directe : Il n’existe pas de seuil de pourcentage IA universellement autorisé dans les thèses et mémoires universitaires. Les règles varient selon l’établissement, la discipline et le type de travail. L’enjeu principal n’est pas le pourcentage détecté, mais la transparence de l’usage et la conformité aux chartes institutionnelles.

Voilà la vérité que personne ne vous dit clairement. Après plus de 40 ans à décortiquer les pratiques académiques, je peux vous affirmer une chose : le problème n’est pas le pourcentage. C’est ce que vous en faites.

Dans les lignes qui suivent, je vais vous révéler ce que les institutions gardent volontairement flou, pourquoi elles le font, et surtout comment naviguer dans cette zone grise. Si vous cherchez des barèmes précis par domaine, consultez notre guide complet sur les limites IA par discipline pour 2025.

Pourquoi les universités restent volontairement floues sur les seuils d’IA

Vous pensez peut-être que votre université est simplement en retard. Détrompez-vous. Ce flou est souvent délibéré.

Préparez-vous à un chiffre surprenant. Selon une enquête de l’UNESCO publiée en septembre 2024, moins de 10% des établissements universitaires dans le monde disposent de directives formelles sur l’IA.

Cela signifie que l’immense majorité des doctorants navigue sans boussole officielle. En France, chaque université, parfois chaque école doctorale, développe ses propres approches — quand elle en développe.

J’ai épluché les chartes disponibles. Prenons l’exemple de la Charte du bon usage des IA génératives de l’Université de Toulouse. Aucun pourcentage n’y est mentionné. Ce que ces chartes encadrent :

- Les usages autorisés (brainstorming, recherche bibliographique, correction linguistique…)

- Les usages interdits (génération de contenu présenté comme original, fabrication de données…)

- Les obligations de transparence (déclarer comment l’IA a été utilisée)

- Les sanctions possibles (de l’avertissement à l’exclusion)

Pourquoi ne pas fixer de chiffres ? La réponse est pragmatique : la technologie évolue bien plus vite que les règlements. Un seuil de 20% fixé en janvier pourrait être obsolète en juin.

Tournons-nous vers les universités américaines. Princeton University a adopté une approche claire : l’important n’est pas “combien” vous avez utilisé l’IA, mais “l’avez-vous déclaré ?” Cette philosophie du disclosure gagne du terrain en France. Pour approfondir, notre guide complet sur la transparence IA académique 2025 détaille les bonnes pratiques.

Comment les institutions redéfinissent les règles du jeu en 2025

Le paysage évolue à une vitesse vertigineuse. Ce qui était vrai il y a six mois peut être complètement dépassé aujourd’hui.

La plupart des doctorants confondent deux choses radicalement différentes dans les rapports Turnitin :

- Le Similarity Score : pourcentage de texte similaire à d’autres sources (plagiat potentiel)

- L’AI Writing Indicator : probabilité que le texte ait été généré par IA

Selon le guide officiel de Turnitin, ce fameux pourcentage IA n’est pas une preuve. C’est une probabilité qui nécessite une interprétation humaine.

Ce que signifie réellement le pourcentage IA de Turnitin :

- ❌ Ce n’est PAS une preuve de fraude

- 📊 C’est une probabilité, pas une certitude

- 👨🏫 Le jugement final appartient à l’enseignant/jury

- ⚖️ Un même % peut être acceptable ou problématique selon le contexte

Voici l’information qui pourrait vous choquer : certaines universités arrêtent complètement d’utiliser la détection IA. L’Université de Waterloo (Canada) a officiellement annoncé l’abandon de cette fonctionnalité, citant une fiabilité insuffisante et des biais contre les étudiants non-anglophones.

Le débat sur le “pourcentage autorisé” occulte une transformation plus profonde. Cette conférence de l’Université Toulouse – Jean Jaurès offre un éclairage précieux :

L’enjeu n’est plus de savoir si vous pouvez utiliser l’IA, mais comment l’intégrer intelligemment. Pour une approche structurée, notre guide sur l’IA éthique pour thèse propose une méthodologie étape par étape.

Les 5 vérités cachées sur les seuils de pourcentage IA

Voici le cœur de ce que personne ne vous dit. Ces vérités pourraient vous éviter bien des sueurs froides.

Vérité #1 : Le même pourcentage peut vous sauver ou vous couler. Imaginez deux scénarios :

Vous avez bien lu : 15% non déclaré peut être plus grave que 25% transparent. Pour éviter les erreurs fatales, consultez notre article sur les 5 erreurs fatales en matière de transparence IA.

Vérité #2 : Les correcteurs IA brouillent les cartes. La frontière entre “correction” (acceptable) et “reformulation” (zone grise) reste incroyablement floue. Notre article sur les vérités cachées des correcteurs IA pour thèses démêle le vrai du faux.

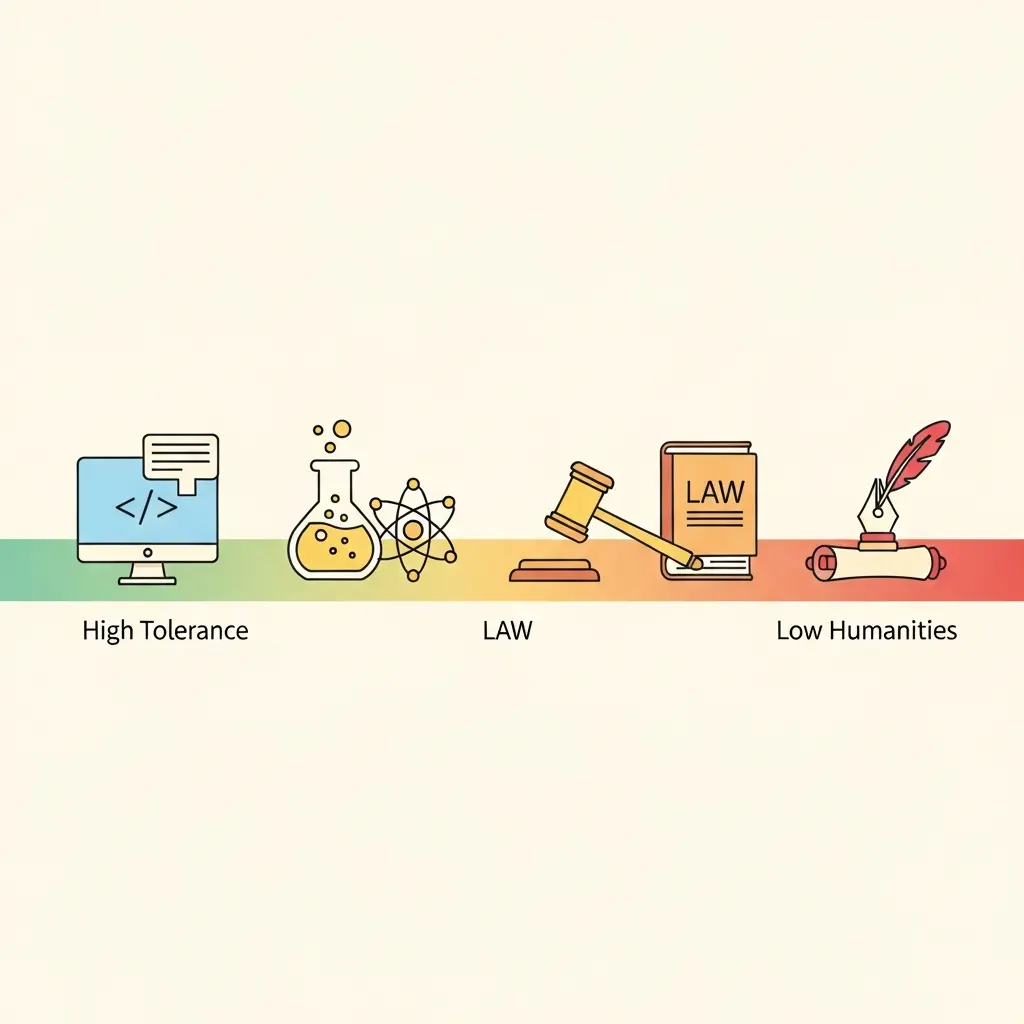

Vérité #3 : Votre discipline change tout. En informatique, utiliser GitHub Copilot est souvent encouragé. En philosophie, utiliser ChatGPT pour construire un argument serait vu comme manquant d’originalité. Pour des barèmes détaillés, notre guide complet par discipline offre un panorama approfondi.

Vérité #4 : Le jury a le dernier mot. Même avec un pourcentage “acceptable”, un jury peut décider que l’usage est problématique. Les facteurs subjectifs : qualité de la réflexion, cohérence stylistique, maîtrise démontrée à l’oral. Pour éviter les pièges, lisez notre article sur les 5 erreurs ChatGPT qui détruisent votre crédibilité.

Vérité #5 : Le vrai risque, c’est l’absence de preuves de votre travail. Ce qui vous protège vraiment :

- 📔 Un journal de bord daté de vos sessions de travail

- 💬 L’historique de vos prompts IA conservés

- 📝 Les versions successives de vos documents

- 🔍 Vos notes de recherche manuscrites ou numériques

Pour construire un cadre éthique solide, notre guide sur l’usage éthique de l’IA dans les mémoires universitaires vous accompagne pas à pas.

📊 Évaluez votre niveau de risque

| Critère | Faible risque ✅ | Risque élevé ⚠️ |

|---|---|---|

| Déclaration d’usage | Transparente et détaillée | Absente ou vague |

| Type d’usage | Brainstorming, reformulation | Argumentation, analyse |

| Documentation | Journal de bord, prompts conservés | Aucune trace |

| Étape concernée | Recherche préliminaire | Rédaction finale |

Prévisions 2025-2026 : vers la fin des “pourcentages autorisés” ?

Un mouvement de fond émerge : plutôt que surveiller et sanctionner, de plus en plus d’universités choisissent de former les étudiants à utiliser l’IA correctement. L’idée est révolutionnaire : un docteur qui ne sait pas utiliser l’IA efficacement sera moins compétitif.

Ma prédiction : d’ici 2026, les thèses pourraient inclure une annexe obligatoire “méthodologie IA” détaillant les outils utilisés. Comment vous y préparer dès maintenant ? En tenant un journal rigoureux de vos usages.

Quels que soient les outils et les évolutions réglementaires, une constante demeure : la valeur d’une thèse réside dans l’apport intellectuel original de son auteur. Le pourcentage n’est qu’un chiffre. Votre réflexion, elle, est irremplaçable.

Leave a Reply