En 2025, ChatGPT s’est infiltré dans pratiquement tous les laboratoires de recherche. Pourtant, un silence troublant persiste dans les couloirs des écoles doctorales. Combien de doctorants osent réellement en parler à leur directeur de thèse ?

Ce paradoxe révèle une réalité que le monde académique peine à affronter : l’intelligence artificielle générative est massivement utilisée, mais rarement déclarée. D’un côté, ces outils sont devenus aussi courants qu’un logiciel de traitement de texte. De l’autre, la peur des sanctions pousse à la clandestinité.

Ce constat, déjà exploré dans notre article sur l’usage éthique de l’IA dans les mémoires universitaires, prend une dimension critique quand il s’agit du doctorat. Ici, les enjeux changent radicalement : c’est votre carrière scientifique qui se joue.

Alors, l’utilisation de ChatGPT pour les thèses universitaires est-elle vraiment autorisée ? La réponse officielle tient en trois mots : « oui, mais… ». Et ce « mais » peut littéralement ruiner une carrière académique si vous n’en saisissez pas toutes les implications.

💡 Réponse rapide

ChatGPT est-il autorisé en thèse en 2025 ? Oui, sous conditions strictes : déclaration transparente, usage limité à certaines tâches, validation par l’établissement. Les règles varient selon les universités et les disciplines. L’absence de déclaration — même pour un usage « mineur » — peut être considérée comme une faute d’intégrité scientifique.

Cet article révèle ce que les guides officiels ne disent pas. Les zones grises que personne n’explique clairement. Les erreurs qui transforment un usage parfaitement légal en fraude académique. Et surtout, comment utiliser ChatGPT en thèse sans jamais risquer votre doctorat.

Ce que disent vraiment les universités (et ce qu’elles omettent)

Avant de plonger dans les zones grises, établissons les faits. Que disent officiellement les institutions sur l’utilisation de ChatGPT en thèse ? Et surtout, qu’omettent-elles de préciser ?

En avril 2025, l’UNESCO a mis à jour son document de référence « Guidance for generative AI in education and research ». Ce texte, bien que non contraignant, influence directement les politiques universitaires mondiales.

« L’IA générative doit être utilisée de manière à préserver l’intégrité académique et la pensée critique des apprenants. »

L’UNESCO insiste sur quatre piliers fondamentaux : l’intégrité (l’IA ne remplace pas le travail intellectuel original), la gouvernance (les établissements définissent des règles claires), la transparence (tout usage doit être déclaré), et la protection des données (attention à ce que vous partagez).

Ce que cela signifie concrètement ? Vous avez le droit d’utiliser ChatGPT, mais le devoir de le faire de manière responsable. Un principe simple en apparence, dont l’application s’avère bien plus complexe.

L’Université d’Oxford, référence mondiale en rigueur académique, a publié des lignes directrices particulièrement éclairantes. Leur politique repose sur trois exigences : l’intégrité académique avant tout, la transparence obligatoire, et la vérification systématique de chaque output.

Mais voici le point crucial que beaucoup négligent : Oxford précise explicitement que « les consignes peuvent varier selon les départements et les enseignants ». Même au sein d’une même université, les règles ne sont pas uniformes. Le piège se referme sur les doctorants qui pensent qu’une autorisation « générale » les protège, alors que leur commission de discipline pourrait avoir une interprétation bien plus restrictive.

Pour approfondir ces principes dans le contexte de votre thèse, consultez notre guide sur l’IA éthique pour thèse : de la question au plan détaillé.

L’évolution spectaculaire des mentalités

Si vous avez commencé votre thèse en 2023, vous avez probablement vécu un véritable ascenseur émotionnel concernant l’IA.

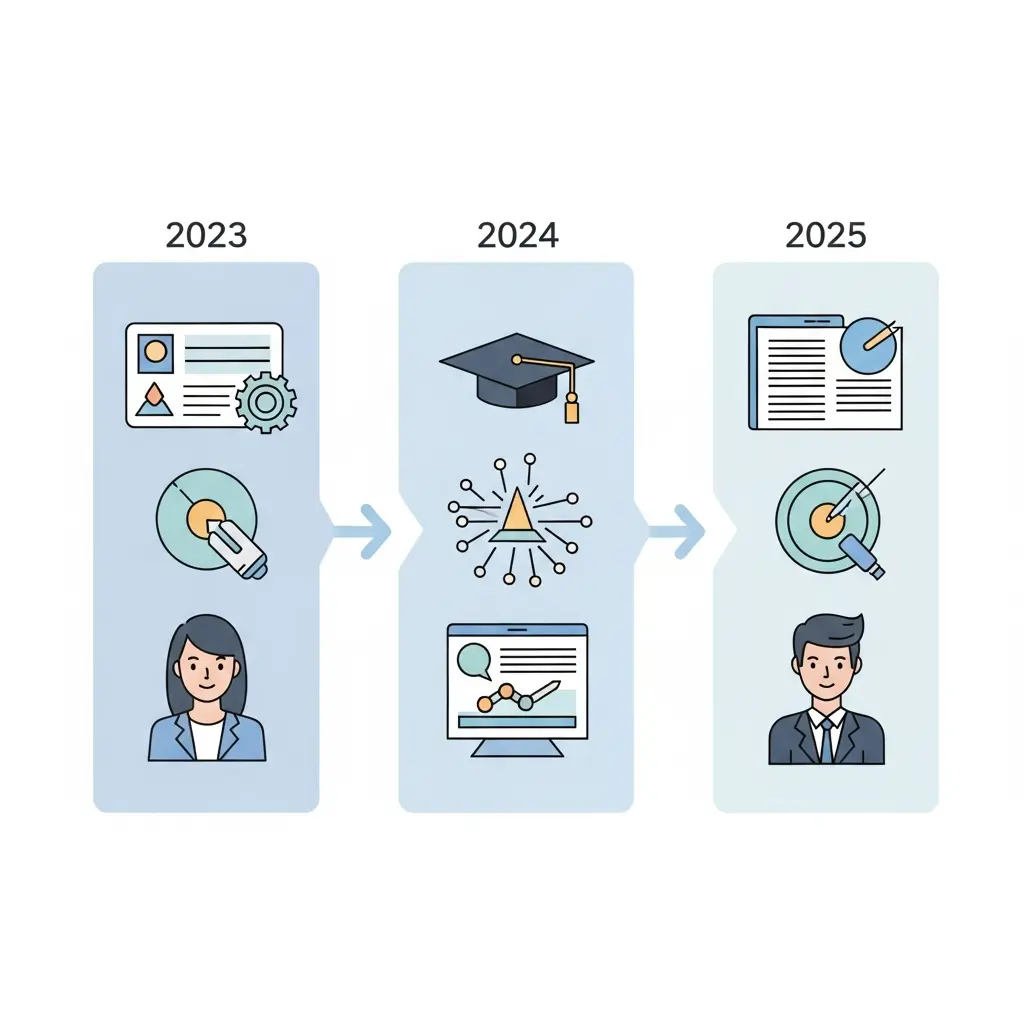

La chronologie est frappante. En 2023, c’était la panique générale : Sciences Po Paris interdit ChatGPT, d’autres universités suivent. L’année 2024 marque une phase d’expérimentation où les interdictions montrent leurs limites. Puis 2025 sonne l’heure des cadres officiels : les universités ne peuvent plus ignorer l’évidence.

Le nouveau paradigme se résume ainsi : « autoriser pour mieux contrôler ». Plutôt que de combattre un usage qu’elles ne peuvent empêcher, les institutions préfèrent l’encadrer. C’est une victoire du pragmatisme sur le dogmatisme.

En France, le G6 (regroupant les plus grands organismes de recherche, dont le CNRS) a publié ses préconisations en juillet 2025. Un changement de paradigme notable : l’IA n’est plus uniquement perçue comme un risque de triche, mais comme un outil d’innovation scientifique. Cette ouverture s’accompagne toutefois d’exigences accrues de transparence et de traçabilité.

L’évolution la plus importante concerne les jurys de thèse. Aujourd’hui, la question systématique est devenue : « Avez-vous utilisé des outils d’IA ? Comment ? Pour quelles tâches ? » Cette question n’est pas posée pour piéger — elle évalue votre honnêteté intellectuelle.

Ce que les jurys vérifient en 2025 :

- La déclaration d’utilisation dans la méthodologie

- La cohérence entre le style écrit et les échanges oraux

- La traçabilité des sources et références

- La capacité à expliquer et défendre chaque choix argumentatif

Pour comprendre en détail ce que ces nouvelles règles impliquent, consultez notre guide complet sur la transparence IA académique en 2025.

Les 4 zones grises que personne n’explique

C’est ici que les choses deviennent vraiment intéressantes. Entre « autorisé » et « interdit » existe un vaste territoire flou où se joue votre crédibilité académique.

Première zone grise : « Autorisé » ne signifie pas « sans limites ». Imaginez ChatGPT comme un assistant de recherche stagiaire. Vous pouvez lui demander d’organiser vos idées, de vérifier votre grammaire, d’explorer des pistes bibliographiques. Mais vous ne lui confieriez jamais la rédaction de votre analyse principale.

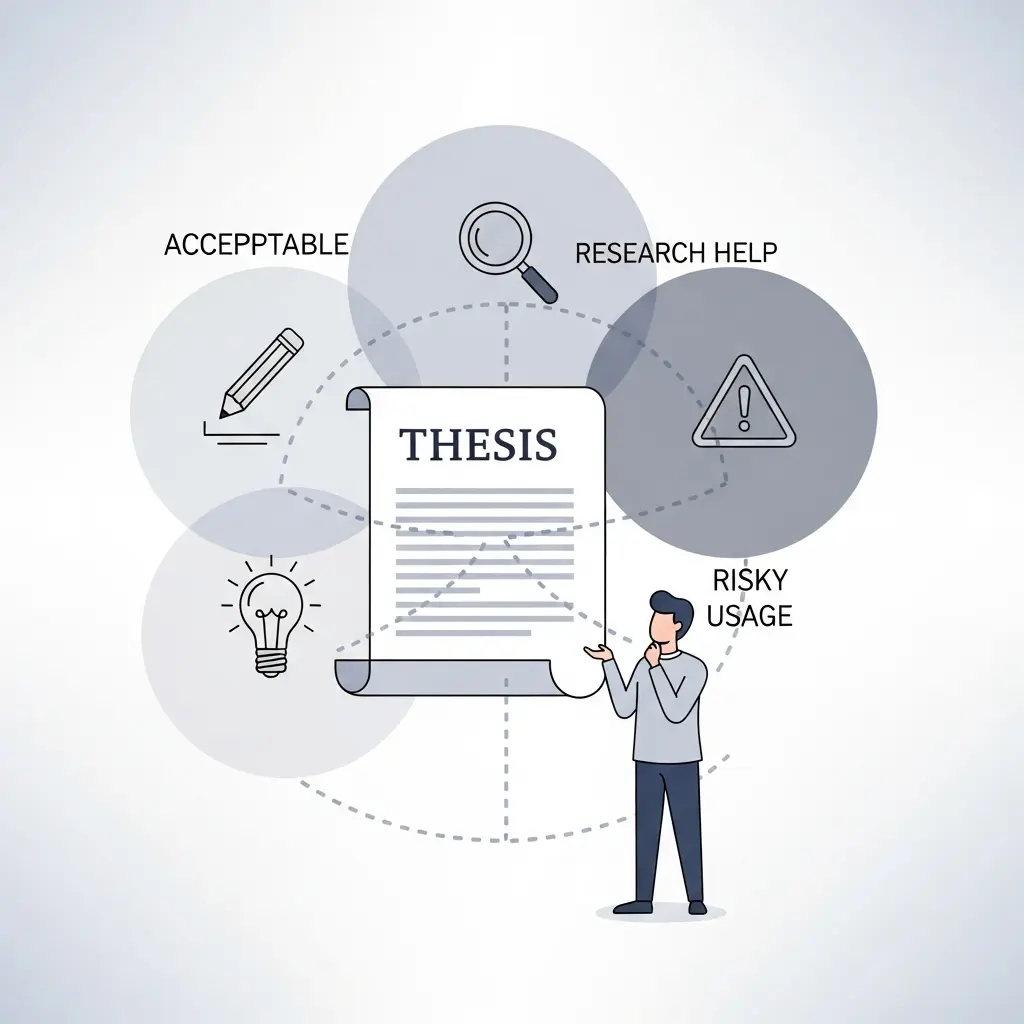

Ce qui est généralement accepté : brainstorming, reformulation de vos propres passages, correction grammaticale, aide à la structuration, traduction avec vérification. Ce qui pose systématiquement problème : rédaction de sections entières, analyse de données, formulation des conclusions, génération d’arguments originaux sans travail critique.

Le piège classique ? Le « j’ai juste reformulé ». Beaucoup de doctorants pensent qu’utiliser ChatGPT pour « améliorer » leur texte est anodin. Mais si la reformulation transforme substantiellement le contenu, vous n’êtes plus l’auteur.

Deuxième zone grise : la question de l’auctorialité. Qui est l’auteur quand l’IA contribue ? Ce débat, loin d’être théorique, a des implications très concrètes. Des concepts comme « mémoire artificielle » ou « auctorialités distribuées » émergent pour penser cette nouvelle réalité.

Ce que cela implique : vous restez l’unique auteur, mais vous devez assumer cette responsabilité pleinement. Chaque phrase, chaque argument, chaque conclusion doit pouvoir être défendu comme s’il venait intégralement de vous — parce qu’il doit venir de vous, même si l’IA a aidé à l’exprimer.

Troisième zone grise : la déclaration « suffisante » vs « insuffisante ». Vous pensez avoir fait ce qu’il fallait en mentionnant ChatGPT quelque part ? Une déclaration vague peut paradoxalement se retourner contre vous. « J’ai parfois utilisé ChatGPT » est trop vague et sous-entend plus que ce qui est dit. Préférez une description précise des tâches assistées, la mention de la version utilisée, et l’explication de votre processus de vérification.

Quatrième zone grise : les différences entre établissements. Votre collègue dans une autre université peut avoir des règles complètement différentes. C’est frustrant, c’est injuste, mais c’est la réalité : il n’existe pas d’harmonisation nationale en France. Consultez la charte d’intégrité de votre établissement, vérifiez le règlement de votre école doctorale, et demandez explicitement à votre directeur de thèse — en gardant une trace écrite.

Pour découvrir les usages sûrs de l’IA dans vos travaux, consultez notre guide sur les outils IA pour planifier et structurer un mémoire académique.

Citer ChatGPT dans votre thèse : le guide définitif

Passons à la pratique. Comment mentionner et citer l’utilisation de ChatGPT de manière appropriée ?

Les principales normes de citation ont été mises à jour. APA 7e édition recommande de citer ChatGPT comme un « logiciel », avec la date d’accès et la version utilisée. Chicago Style (mise à jour juin 2025) privilégie une approche descriptive plutôt que bibliographique. MLA traite l’IA comme une source à citer si elle a fourni du contenu directement utilisé.

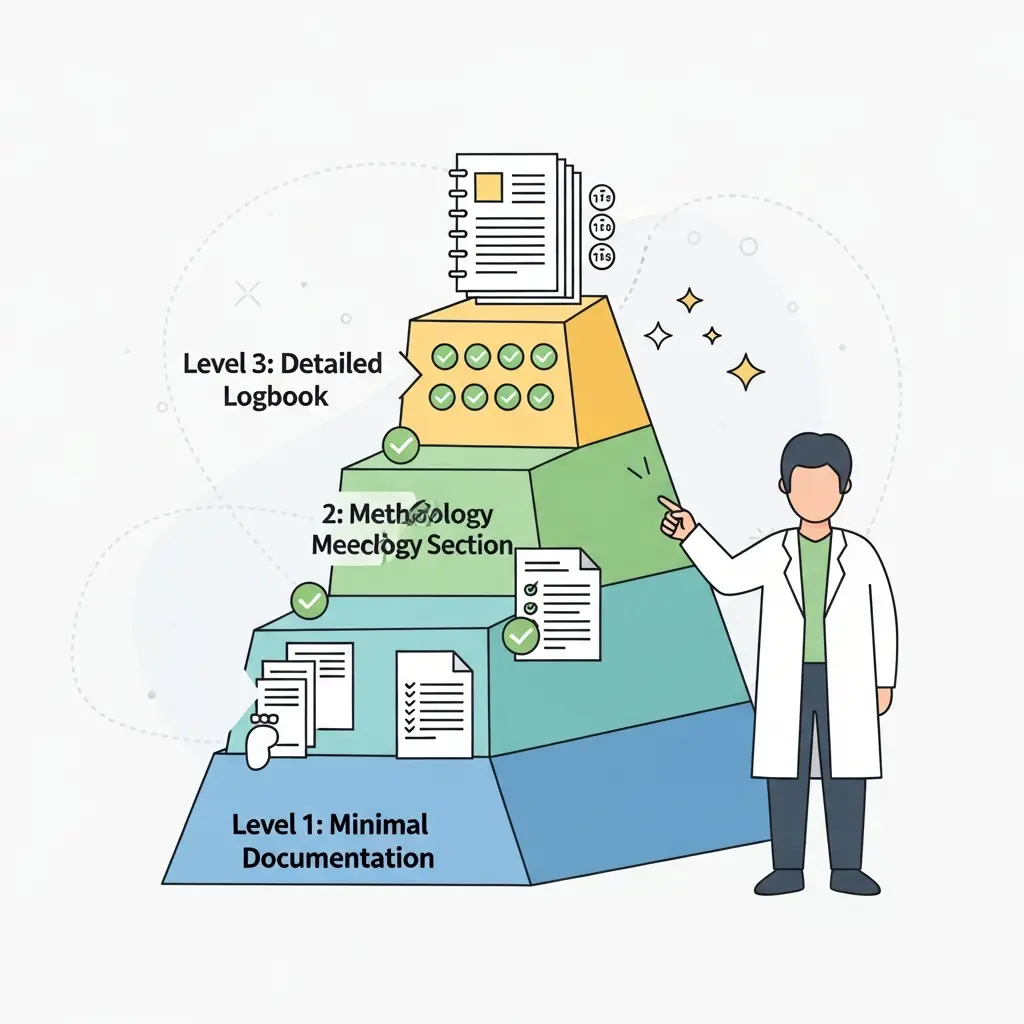

Selon l’ampleur de votre utilisation, optez pour différents niveaux de déclaration. Le niveau minimum (usage ponctuel) : une mention dans les remerciements ou en note de bas de page, approprié pour des corrections linguistiques mineures. Le niveau standard (usage régulier) : une section dédiée dans votre chapitre méthodologique décrivant les types de tâches concernées. Le niveau optimal (usage significatif) : un véritable « journal de bord IA » documentant vos interactions importantes, prompts utilisés et modifications apportées.

Exemple de déclaration adaptable

« Dans le cadre de cette recherche, l’outil ChatGPT (version GPT-4, OpenAI, consulté entre [dates]) a été utilisé pour [tâches spécifiques : reformulation stylistique, vérification grammaticale, etc.]. Chaque output a fait l’objet d’une vérification critique et d’une réécriture personnelle. L’analyse, l’argumentation et les conclusions sont entièrement de mon fait. »

Pour une méthodologie complète de traçabilité, consultez notre guide sur l’assistant IA pour thèse : méthodes et conformité doctorat 2025.

Ce qu’il faut retenir

L’utilisation de ChatGPT en thèse n’est ni interdite ni totalement libre. Elle s’inscrit dans un cadre exigeant transparence, responsabilité et honnêteté intellectuelle. Les règles varient selon les établissements, les disciplines et même les directeurs de thèse — ce qui rend la vigilance indispensable.

Trois principes guideront votre parcours : déclarez toujours votre usage, même minimal ; vérifiez et réécrivez tout ce que l’IA produit ; et assumez l’entière responsabilité de chaque mot de votre thèse. L’IA peut être un allié précieux dans votre travail doctoral, à condition de ne jamais oublier que c’est vous, et vous seul, qui êtes l’auteur de votre recherche.

Pour approfondir ces questions et maîtriser l’art de déclarer l’IA sans risque, lisez notre article sur comment déclarer l’IA dans vos travaux académiques sans risquer l’exclusion.

Leave a Reply