Imaginez la scène : vous êtes convoqué·e dans le bureau de votre directeur de mémoire. Votre cœur bat la chamade. Sur l’écran, un rapport de détection IA affiche un pourcentage inquiétant. Vous avez utilisé ChatGPT pour reformuler quelques paragraphes — rien de méchant, pensiez-vous. Sauf que vous n’avez rien déclaré. Et maintenant, vous risquez l’annulation de votre semestre entier.

Ce scénario n’est pas fictif. Il se répète dans des dizaines d’universités françaises et européennes chaque mois. Depuis l’explosion de ChatGPT fin 2022, les établissements d’enseignement supérieur ont complètement transformé leurs politiques. L’University of Sydney, par exemple, impose dès le Semester 2 2025 une obligation systématique de reconnaître tout usage d’IA générative — même pour une simple correction grammaticale.

Et la France ? Elle suit le mouvement, parfois dans un flou artistique qui peut vous piéger si vous ne faites pas attention.

Règles de transparence pour l’utilisation de l’IA en contexte académique : Ensemble des obligations imposées par les établissements d’enseignement supérieur concernant la déclaration, la documentation et la citation des outils d’intelligence artificielle utilisés dans les travaux universitaires.

Dans cet article, je vais vous révéler les 5 erreurs fatales que commettent la majorité des étudiants en matière de transparence IA. Des erreurs qui peuvent transformer un travail prometteur en cauchemar administratif. Mais surtout, je vais vous donner les solutions concrètes pour éviter chacune d’elles.

Parce que comprendre les règles de transparence pour l’utilisation de l’IA en contexte académique, ce n’est pas seulement éviter les ennuis — c’est aussi vous démarquer positivement dans un monde où la maîtrise éthique de l’IA devient une compétence valorisée.

Prêt·e à sécuriser votre parcours académique ? Allons-y.

👉 Pour une vision complète du cadre réglementaire, consultez notre Guide complet de la transparence IA académique 2025.

Souvenez-vous de janvier 2023. Sciences Po Paris fait les gros titres en interdisant purement et simplement l’usage de ChatGPT. La panique est générale. Les universités du monde entier oscillent entre blocage total et attentisme prudent.

Deux ans plus tard, le paysage a radicalement changé. L’interdiction pure et dure s’est révélée inapplicable et, surtout, contre-productive. Interdire l’IA à des étudiants qui entreront dans un monde professionnel où elle sera omniprésente ? Cela n’avait aucun sens pédagogique.

L’UNESCO a publié dès septembre 2023 ses recommandations sur l’IA générative dans l’éducation et la recherche, mises à jour en avril 2025. Le message central ? La responsabilité humaine reste première, mais l’IA peut être un outil précieux — à condition d’en encadrer l’usage.

La tendance mondiale est désormais claire : passage de l’interdiction à la politique encadrée. Concrètement, cela signifie :

- Distinction entre évaluations “secure” et “open” : Certains examens interdisent strictement l’IA (conditions surveillées), d’autres l’autorisent sous conditions (travaux à la maison).

- Obligation généralisée d’acknowledgement : Même quand l’IA est autorisée, vous devez déclarer comment vous l’avez utilisée.

- Sanctions graduées mais réelles : Du simple avertissement à l’annulation du diplôme, selon la gravité et la récidive.

En France, le flou persiste. Chaque université, parfois chaque UFR, applique ses propres règles. Ce qui est acceptable à Paris-Saclay peut être sanctionné à Bordeaux. Cette disparité est l’une des raisons pour lesquelles tant d’étudiants commettent des erreurs de transparence IA — ils ne savent tout simplement pas quelles règles s’appliquent à eux.

📚 Ressource internationale : L’UNESCO a publié un cadre de référence sur l’IA générative dans l’éducation, insistant sur la responsabilité humaine et les usages encadrés.

La bonne nouvelle ? En comprenant les tendances internationales et les erreurs les plus courantes, vous pouvez vous protéger quel que soit votre établissement.

👉 Découvrez ce que personne ne vous dit sur la transparence IA académique — les zones grises que vos profs n’expliquent pas.

Passons maintenant au cœur du sujet. Ces erreurs, je les ai vues se répéter des centaines de fois. Elles semblent anodines sur le moment, mais leurs conséquences peuvent être dévastatrices.

Erreur n°1 — Ne pas déclarer du tout l’utilisation de l’IA

Le piège : “Personne ne saura.” C’est ce que se disent des milliers d’étudiants chaque jour. Après tout, qui va vérifier ? Et puis, ce n’était qu’un petit coup de pouce pour reformuler un paragraphe…

La réalité : Les logiciels de détection IA (Turnitin, GPTZero, Copyleaks) s’améliorent chaque semestre. Mais le vrai danger n’est pas là. Ce sont les incohérences stylistiques qui alertent les correcteurs. Un paragraphe soudainement plus fluide, un vocabulaire inhabituellement soutenu, une structure argumentative qui ne ressemble pas à vos écrits habituels — voilà ce qui déclenche les soupçons.

Les conséquences :

- Accusation de fraude académique (même si vous n’avez pas “triché” au sens classique)

- Nullité du travail concerné

- Exclusion temporaire ou définitive selon les établissements

- Mention au dossier qui peut compromettre votre poursuite d’études

J’ai rencontré un étudiant en M1 qui a perdu son année pour un résumé de 500 mots. 500 mots non déclarés. Il pensait que c’était trop peu pour compter. Son université n’était pas du même avis.

✅ Règle d’or : Dans le doute, déclarez. Une déclaration inutile ne vous pénalise jamais ; une omission peut vous coûter votre diplôme.

👉 Apprenez la méthode complète pour déclarer l’IA dans vos travaux sans risquer l’exclusion.

Erreur n°2 — Faire une déclaration vague ou incomplète

Le piège : Vous avez compris qu’il faut déclarer. Alors vous écrivez : “J’ai utilisé ChatGPT pour ce travail.” Mission accomplie, non ?

Pas du tout.

Une déclaration vague est presque aussi problématique qu’une absence de déclaration. Pourquoi ? Parce qu’elle ne permet pas au correcteur de comprendre comment et dans quelle mesure vous avez utilisé l’outil.

Selon les recommandations de l’University of Sydney, une déclaration minimale doit inclure :

- Nom de l’outil : ChatGPT, Claude, Gemini, etc.

- Version utilisée : GPT-4, GPT-4o, Claude 3.5 Sonnet…

- Éditeur : OpenAI, Anthropic, Google…

- URL d’accès : chat.openai.com, claude.ai…

- Description précise de l’usage : brainstorming, reformulation, correction…

Template de déclaration :

J’ai utilisé [Nom de l’outil] (version [X], édité par [Éditeur], accessible à [URL]) pour [description précise : brainstorming initial / reformulation de 3 paragraphes / vérification grammaticale]. Les prompts utilisés et les outputs générés sont documentés en annexe [X].

Cette précision peut sembler excessive. Elle ne l’est pas. Elle vous protège en cas de contestation, et elle démontre une maturité méthodologique que les jurys apprécient.

👉 Pour approfondir les risques disciplinaires, consultez notre article sur les 5 erreurs fatales de transparence IA dans les travaux académiques.

Erreur n°3 — Confondre citation et simple reconnaissance

Le piège : Traiter tous les usages IA de la même façon, comme si c’était un bloc homogène.

La distinction cruciale — et peu d’étudiants la connaissent : il existe deux types de déclaration selon la nature de votre usage.

Selon le guide de Georgetown University Library, voici comment distinguer :

| Type d’usage | Action requise | Exemple |

|---|---|---|

| Génération de texte | Citation complète (APA/MLA) | Paragraphe rédigé par Claude |

| Paraphrase assistée | Citation + mention | Reformulation d’un concept |

| Correction grammaticale | Reconnaissance en note | Grammarly, LanguageTool |

| Traduction assistée | Reconnaissance en note | DeepL pour sources étrangères |

| Brainstorming | Reconnaissance en annexe | Liste d’idées générée |

Concrètement : si l’IA a généré du contenu que vous avez intégré (même reformulé), vous devez le citer comme une source. Si l’IA vous a aidé de manière fonctionnelle (relecture, traduction), une simple reconnaissance en note ou annexe suffit généralement.

Erreur n°4 — Ne pas documenter ses prompts et ses échanges

Le piège : Utiliser l’IA “à la volée”, sans garder aucune trace. Vous posez votre question, vous récupérez la réponse, vous fermez l’onglet. Efficace, non ?

Fatal.

Pourquoi ? Parce que si votre travail est contesté — et avec les outils de détection actuels, cela peut arriver même à tort — vous n’aurez aucun moyen de prouver votre bonne foi.

De plus en plus d’établissements exigent explicitement :

- Un journal de bord IA : date, outil, prompts, outputs

- Des captures d’écran horodatées de vos conversations

- Un versioning de vos documents : différentes versions montrant votre progression

La méthode que je recommande :

- Créez un journal de bord IA (Google Doc, Notion, simple fichier texte)

- Pour chaque session : notez la date + l’outil + le prompt exact + l’output obtenu

- Conservez les conversations : exportez en PDF ou faites des captures d’écran

- Archivez en annexe : joignez au travail final si demandé (ou gardez prêt à fournir)

Cela prend 5 minutes supplémentaires par session. Ces 5 minutes peuvent sauver votre année.

👉 Pour un workflow complet de traçabilité, consultez notre guide Assistant IA pour thèse : conformité doctorat 2025.

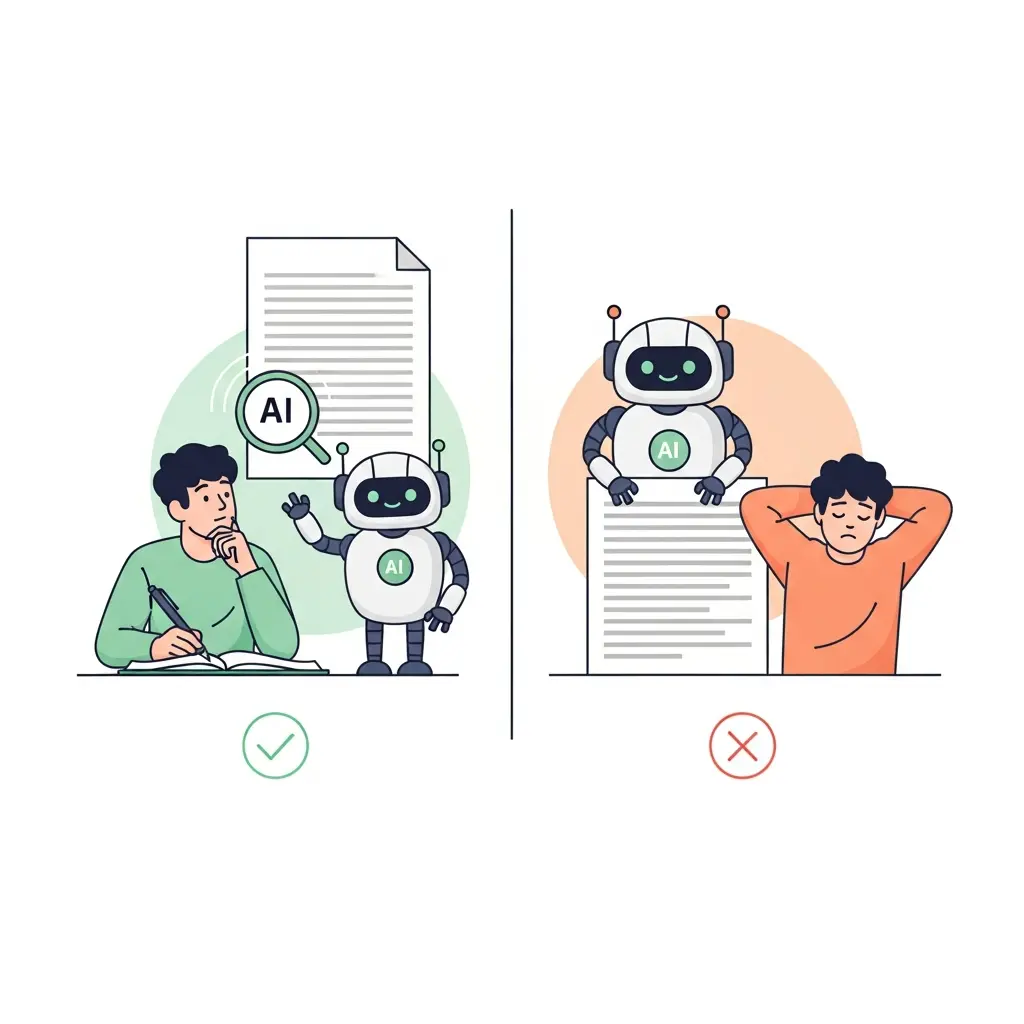

Erreur n°5 — Laisser l’IA penser à votre place

Le piège le plus dangereux : utiliser l’IA non pas comme assistant, mais comme remplaçant de votre réflexion.

Vous vous dites : “Tant que je déclare, tout va bien.” Erreur. Les règles de transparence IA ne concernent pas seulement la déclaration, mais aussi la nature de l’usage.

La ligne rouge : ce que les jurys évaluent dans vos travaux, c’est votre capacité à analyser, synthétiser, argumenter. Si l’IA fait ce travail à votre place — même déclaré — votre travail peut être invalidé pour non-respect des objectifs pédagogiques.

| ✅ Acceptable (assistance) | ❌ Inacceptable (substitution) |

|---|---|

| Reformuler vos propres idées | Générer l’argumentation complète |

| Vérifier la grammaire | Rédiger la problématique |

| Suggérer une structure | Créer l’analyse de données |

| Résumer vos lectures | Produire la revue de littérature |

⚖️ Norme internationale : Selon les recommandations ICMJE, l’IA ne peut jamais être considérée comme auteur car elle ne peut assumer la responsabilité du contenu. Vous restez seul·e responsable de ce que vous rendez.

Pensez-y comme à une analogie sportive : un entraîneur peut vous conseiller, vous corriger, vous motiver. Mais c’est vous qui devez courir le marathon. Si l’entraîneur court à votre place, vous n’avez pas terminé la course — même si vous le déclarez.

👉 Découvrez comment transformer l’IA en avantage académique éthique dans notre article sur l’usage éthique de l’IA dans les mémoires universitaires.

Si 2024 était encore l’année du bricolage institutionnel, 2025 marque un tournant vers l’harmonisation. De plus en plus d’établissements français s’inspirent des frameworks anglo-saxons pour construire leurs propres politiques.

Les influences se multiplient :

- UNESCO : cadre éthique et pédagogique

- HCÉRES : intégration progressive de critères IA dans l’évaluation de la recherche

- CPU (Conférence des Présidents d’Université) : travail sur des recommandations nationales

Bonne nouvelle : la documentation va devenir plus facile. Les grands acteurs de l’IA commencent à intégrer des fonctionnalités de logging automatique. ChatGPT propose désormais un historique exportable, Claude permet de partager des conversations, et des plugins universitaires s’intègrent directement aux LMS comme Moodle ou Canvas.

Voici une prédiction que je fais avec confiance : d’ici 2026, la capacité à utiliser l’IA de façon critique et transparente sera explicitement évaluée dans de nombreux cursus. Cela signifie des modules de formation obligatoires, des évaluations spécifiques de votre méthodologie IA, et un avantage compétitif pour les étudiants qui maîtrisent déjà ces compétences.

En d’autres termes : maîtriser les règles de transparence pour l’utilisation de l’IA en contexte académique aujourd’hui, c’est prendre de l’avance sur demain.

Résumons. Les 5 erreurs fatales à éviter absolument :

- Ne pas déclarer — même pour un usage minime

- Déclarer vaguement — sans préciser outil, version, usage exact

- Confondre citation et reconnaissance — adapter le niveau de déclaration au type d’usage

- Ne pas documenter — garder trace de vos prompts et échanges

- Laisser l’IA substituer votre réflexion — l’IA assiste, elle ne remplace pas

La transparence IA n’est pas une contrainte bureaucratique. C’est une compétence d’avenir. Les étudiants qui la maîtrisent aujourd’hui seront les professionnels les plus recherchés demain — ceux qui savent utiliser l’IA de façon éthique, critique et documentée.

Votre diplôme mérite mieux qu’un risque évitable. Prenez 5 minutes pour documenter, 30 secondes pour déclarer, et vous dormirez tranquille.

👉 Pour aller plus loin, téléchargez notre Guide complet de la transparence IA académique 2025 — avec templates, checklists et exemples concrets.

Leave a Reply